引言

在人工智能领域,模型的开源不仅是技术的进步,更是行业的一次重大变革。阿里云近日宣布,通义千问Qwen2.5-Omni-7B正式开源,这一消息在科技界引起了广泛关注。作为通义系列模型中的首个端到端全模态大模型,Qwen2.5-Omni-7B具有强大的智能语音应用潜力,能够处理文本、图像、音频等多种输入,实时进行分析处理。这一举措标志着阿里云在人工智能领域取得了新的突破,将为用户提供更加全面和智能的服务。接下来,我们将深入探讨阿里云通义系列模型的开源之路、Qwen2.5-Omni-7B的技术特点以及其应用前景。

阿里云通义系列模型的开源之路

阿里云通义系列模型自推出以来,一直备受关注。该系列模型基于Transformer架构,具有强大的学习和推理能力,能够应用于多领域的自然语言处理任务。在通义系列中,Qwen2.5-Omni-7B是规模最大、功能最全面的模型之一,为用户提供了更加全面和智能的语言理解和应用解决方案。

通义系列模型的开源不仅是技术的分享,更是对行业的一次贡献。通过开源,阿里云不仅能够促进技术的共享和发展,还能够吸引更多的研究人员和开发者加入,共同推动人工智能技术的进步。此外,开源还能够提高模型的透明度和可靠性,使得用户能够更加放心地使用。

通义千问Qwen2.5-Omni-7B的技术特点

通义千问Qwen2.5-Omni-7B作为通义系列中的佼佼者,具有以下几个显著的技术特点:

大规模参数

Qwen2.5-Omni-7B拥有70亿参数规模,是一个庞大而复杂的神经网络模型。这一庞大的参数规模使得模型具有强大的表达能力和泛化能力,能够处理复杂的自然语言处理任务。通过大规模的参数训练,模型能够更好地理解和生成自然语言,提高了语言理解和生成的准确性和流畅性。

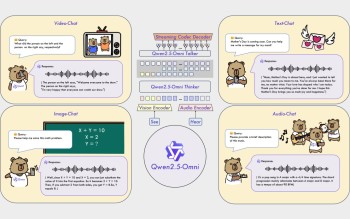

全模态感知

Qwen2.5-Omni-7B是一个端到端的全模态大模型,可以处理文本、图像、音频等多种输入数据,并实时进行联合推理和处理。这一全模态感知能力使得模型能够更好地理解和处理多种类型的数据,提高了模型的应用范围和灵活性。例如,在智能语音助手中,模型不仅能够理解用户的语音指令,还能够根据用户的语音和图像输入进行联合推理,提供更加智能和便捷的服务。

智能语音应用

Qwen2.5-Omni-7B在智能语音应用领域具有前景,能够实现听说写全能的AI助手功能。通过强大的语音识别和语音合成能力,模型能够实现自然语言的双向转换,为用户提供更加便捷和智能的语音交互体验。例如,用户可以通过语音输入进行搜索、问答、翻译等操作,模型能够实时进行语音识别和语音合成,提供准确和流畅的语音交互体验。

阿里云通义系列模型的应用前景

阿里云通义系列模型的开源将为人工智能行业带来新的发展机遇和挑战。这种大规模、全模态的模型在自然语言处理、语音识别、图像处理等领域具有广泛的应用前景,可以为用户提供更加智能和便捷的服务体验。

自然语言处理

在自然语言处理领域,Qwen2.5-Omni-7B能够应用于多种任务,如语言翻译、文本生成、情感分析等。通过强大的语言理解和生成能力,模型能够提供更加准确和流畅的翻译服务,提高用户的翻译体验。此外,模型还能够根据用户的输入生成相应的文本,提供智能写作助手功能,帮助用户提高写作效率和质量。

语音识别

在语音识别领域,Qwen2.5-Omni-7B能够实现高精度的语音识别,为用户提供更加智能和便捷的语音交互体验。通过强大的语音识别和语音合成能力,模型能够实现自然语言的双向转换,提供准确和流畅的语音交互体验。例如,用户可以通过语音输入进行搜索、问答、翻译等操作,模型能够实时进行语音识别和语音合成,提供便捷和智能的语音交互服务。

图像处理

在图像处理领域,Qwen2.5-Omni-7B能够应用于多种任务,如图像分类、目标检测、图像生成等。通过强大的图像理解和生成能力,模型能够提供更加智能和便捷的图像处理服务。例如,模型能够根据用户的输入生成相应的图像,提供智能图像生成功能,帮助用户提高图像处理效率和质量。

结语

阿里云通义千问Qwen2.5-Omni-7B的开源,标志着人工智能技术的一次重大突破。通过强大的全模态感知能力和智能语音应用潜力,Qwen2.5-Omni-7B为用户提供了更加全面和智能的服务体验。未来,随着人工智能技术的不断发展和应用,阿里云通义系列模型将在智能语音、智能图像等领域发挥越来越重要的作用,为用户带来更加智能和便捷的服务体验。